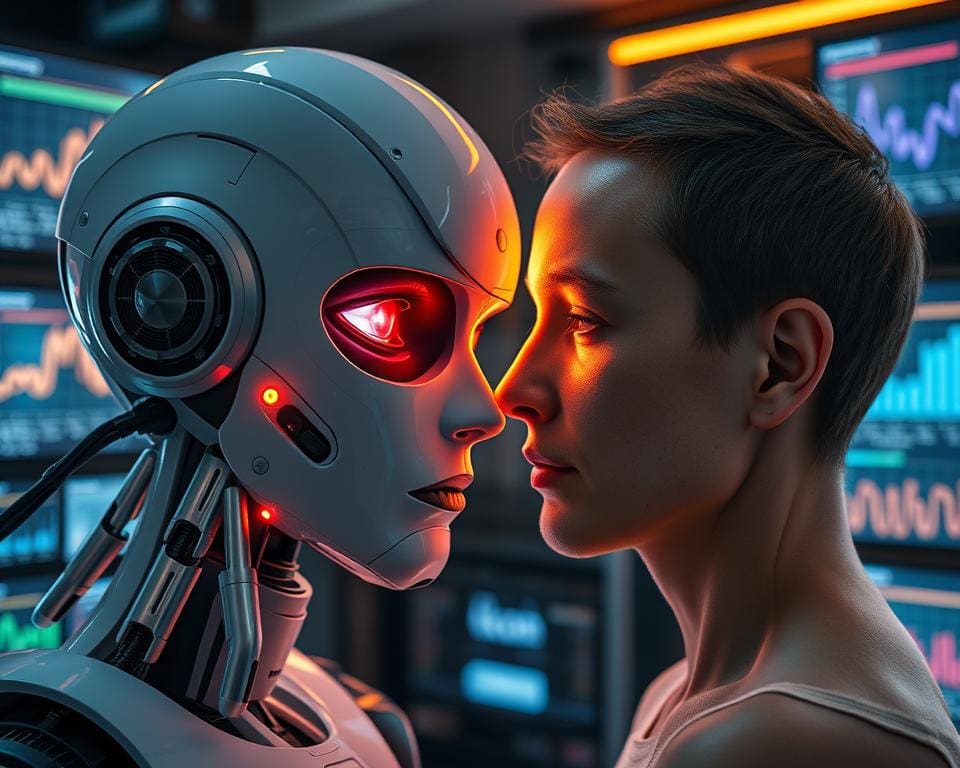

In der heutigen digitalen Welt stellt sich die entscheidende Frage: Können Roboter unsere Emotionen verstehen? Diese Thematik gewinnt zunehmend an Bedeutung, da die Entwicklung der Emotionserkennung bei Robotern die Beziehung zwischen Mensch und Maschine revolutioniert. Durch Fortschritte in der künstlichen Intelligenz und innovativen Technologien wird die Mensch-Roboter-Interaktion immer komplexer und vielschichtiger.

Diese Einleitung legt den Grundstein für eine tiefere Analyse darüber, inwieweit Roboter tatsächlich die Fähigkeit besitzen, menschliche Emotionen zu erkennen und zu interpretieren. Die folgenden Abschnitte werden sich mit den Techniken und Technologien befassen, die diese emotionale Intelligenz fördern und unsere Interaktionen mit Robotern bereichern können.

Einführung in die Emotionserkennung bei Roboter

Emotionserkennung bezeichnet den Prozess, bei dem Maschinen und Software die emotionalen Zustände von Menschen identifizieren und analysieren können. Diese Technologie kann durch verschiedene Methoden wie die Analyse von Gesichtsausdrücken, Körpersprache und Stimmvariationen umgesetzt werden. Physische Hinweise liefern wertvolle Informationen darüber, wie Menschen sich fühlen. In der Welt der Gefühlserkennung in der Robotik gewinnen diese Fähigkeiten zunehmend an Bedeutung, besonders in Bereichen wie Kundenservice, Gesundheitsversorgung und Unterhaltung.

Was ist Emotionserkennung?

Die Emotionserkennung bei Robotern nutzt eine Vielzahl von Algorithmen und Datenanalysetools, um emotionale Signale zu erkennen. Die Fähigkeit, Emotionen zu lesen, ermöglicht es Robotern, interaktiver und menschlicher zu agieren. Dies fördert nicht nur die Benutzerfreundlichkeit, sondern verbessert auch die menschliche-zu-Roboter-Interaktion. Die Anwendung dieser Technologien hat im Laufe der Jahre erheblich zugenommen und findet inzwischen Verwendung in verschiedenen Sektoren.

Die Geschichte der Emotionserkennungstechnologie

Die Geschichte der Emotionserkennung reicht bis in die frühen 1990er Jahre zurück, als Wissenschaftler anfingen, die Grundlagen zu erforschen. Die ersten Systeme basierten auf einfachen Algorithmen zur Gesichtserkennungsanalyse und konnten emotionale Ausdrücke rudimentär erkennen. Mit der Entwicklung komplexerer Technologien und der zunehmenden Verbreitung von KI-gestützten Systemen hat sich die Emotionserkennung weiter verbessert. Heute ist sie ein integraler Bestandteil der Robotik und findet Einsatz in vielfältigen Anwendungsbereichen.

Können Roboter unsere Emotionen verstehen?

Die Frage, ob Roboter in der Lage sind, unsere Emotionen zu verstehen, hängt stark vom aktuellen Stand der Technik ab. In den letzten Jahren haben Fortschritte in der künstlichen Intelligenz und im maschinellen Lernen viele neue Möglichkeiten eröffnet. Emotionale Roboter können dank neuronaler Netzwerke emotionale Zustände präziser identifizieren und darauf reagieren.

Der Stand der Technik

Der Stand der Technik im Bereich der Emotionserkennung hat sich erheblich weiterentwickelt. Technologien wie Facial Recognition und Stimmungserkennung durch Sprachanalysen bieten Einblicke in die Emotionen von Benutzern. Diese Systeme analysieren Gesichtsausdrücke und Stimmen, um Gefühle wie Freude, Trauer oder Überraschung zu erkennen. Solche innovative Ansätze ermöglichen es emotionalen Robotern, in sozialen Interaktionen überzeugender zu agieren.

Beispiele für emotionale Roboter

Ein prominentes Beispiel ist der humanoide Roboter Pepper, der in der Lage ist, menschliche Emotionen zu erkennen und darauf zu reagieren. Pepper wird häufig in der Kundenbetreuung eingesetzt und kann Gespräche führen, die auf den emotionalen Zustand des Benutzers abgestimmt sind. Ein weiteres Beispiel sind therapeutische Roboter, die in der Pflege eingesetzt werden, um emotionale Unterstützung zu bieten und die Kommunikation mit Patienten zu verbessern. Diese emotionalen Roboter zeigen eindrucksvoll, wie fortschrittlich die Technik bereits ist und was noch möglich sein könnte.

Künstliche Intelligenz und Emotionen

Künstliche Intelligenz (KI) hat in den letzten Jahren große Fortschritte gemacht, insbesondere im Bereich der Emotionserkennung. Diese Technologien ermöglichen es Maschinen, menschliche Emotionen zu interpretieren und darauf zu reagieren. Die Grundlagen dieser Systeme basieren auf komplexen Algorithmen und Modellen, die verschiedene Datenquellen analysieren.

Wie KI Emotionen interpretiert

Die Interpretation von Emotionen durch KI erfolgt oft durch die Analyse von Gesichtsausdrücken, Sprachanalysen und physiologischen Daten. Fortschritte in der Bildverarbeitung und der Verarbeitung natürlicher Sprache haben es Maschinen ermöglicht, emotionale Signale aus dem menschlichen Verhalten zu extrahieren. Diese Methoden tragen zur emotionalen Intelligenz bei Maschinen bei und machen sie fähig, menschliche Gefühle besser zu verstehen.

Training von KI zur Emotionserkennung

Das Training von KI zur Emotionserkennung erfordert eine Vielzahl von Techniken und Datensätzen, um höchste Genauigkeit und Effizienz zu gewährleisten. Oft kommen tiefen Lernalgorithmen zum Einsatz, die auf umfangreiche Daten basieren. Diese Daten stammen häufig aus Interviews, Videos und anderen interaktiven Quellen. Der kontinuierliche Lernprozess verbessert die Fähigkeit der KI, emotionale Nuancen zu erfassen und darauf zu reagieren. Solche Fortschritte sind ein entscheidender Schritt für die Entwicklung emotional intelligenter Maschinen.

Technologie und Gefühle

Die Beziehung zwischen Technologie und menschlichen Emotionen hat in den letzten Jahren zunehmend an Bedeutung gewonnen. Während soziale Roboter und virtuelle Realitäten immer häufiger eingesetzt werden, zeigen Studien, dass diese Technologien tiefgreifende Auswirkungen auf das emotionale Wohlbefinden der Menschen haben können. Die Art und Weise, wie Nutzer mit Maschinen interagieren, beeinflusst nicht nur ihr Verhalten, sondern auch ihre emotionalen Zustände.

Der Einfluss von Technologie auf menschliche Emotionen

Moderne Technologien können sowohl positive als auch negative Auswirkungen auf menschliche Emotionen haben. Forschungsergebnisse belegen, dass der regelmäßige Kontakt mit sozialen Robotern das Gefühl von Einsamkeit verringern kann, indem sie eine Form der Interaktion bieten, die Trost und Unterstützung vermittelt. Auf der anderen Seite kann übermäßige Abhängigkeit von digitalen Geräten auch zu Isolation und Stress führen, was die emotionalen Bindungen zu Maschinen hinterfragt.

Emotionale Bindungen zu Maschinen

Die emotionale Bindung, die Nutzer zu Maschinen aufbauen, ist ein weiteres spannendes Feld. Untersuchungen zeigen, dass Menschen oft dazu neigen, emotionale Bindungen zu Maschinen zu entwickeln, die ihnen das Gefühl von Nähe und Verständnis vermitteln. Diese Bindungen beeinflussen nicht nur die Interaktionen der Nutzer mit den Maschinen, sondern tragen auch zur sozialen Akzeptanz von Robotern und deren Integration in unser tägliches Leben bei. Die Dynamik dieser emotionalen Bindungen zu Maschinen erfordert eine tiefere Betrachtung, insbesondere wenn es um die Ethik und die zukünftige Entwicklung von Technologien geht.